دستهبندی نشده

یادگیری نظارت شده

یادگیری نظارت شده (Feature Selection،Neural Networks، KNN، SVM، Decision Tree …)

یادگیری نظارت شده به مجموعه داده های آشکاری متکی است که توسط متخصصان برچسب گذاری شده اند. الگوریتم های ویژگی مهندسی شده برای به حداقل رساندن خطای پیش بینی آموزش داده شده اند، که اندازه گیری تفاوت بین برچسب های پیش بینی شده و برچسب های شناخته شده است. نمونه هایی از این الگوریتم ها عبارتند از طبقه بندی Naive Bayes، رگرسیون خطی و لجستیک، ماشین های بردار پشتیبان (SVM) و جنگل های تصادفی. درجه بندی هیستوپاتولوژی اسلایدهای آسیب شناسی دیجیتالی نمونه خوبی از کاربرد یادگیری تحت نظارت است که تصاویر توسط پاتوبیولوژیست ها برای سرطان پروستات در مقابل غیر سرطانی و برای درجه های مختلف گلیسون برچسب گذاری می شوند. به عنوان مثال SVM، می آموزد که چگونه تصاویر جدید و بدون برچسب را به عنوان خوش خیم یا بدخیم طبقه بندی کند و آنها را در “نقشه احتمال سرطان” برچسب گذاری کند.

Feature selection

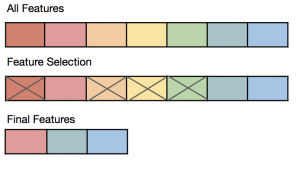

انتخاب ویژگی فرآیند کاهش تعداد متغیرهای ورودی هنگام توسعه یک مدل پیشبینی است.کاهش تعداد متغیرهای ورودی برای کاهش هزینه محاسباتی مدل سازی و در برخی موارد برای بهبود عملکرد مدل مطلوب است.روشهای انتخاب ویژگی مبتنی بر آمار شامل ارزیابی رابطه بین هر متغیر ورودی و متغیر هدف با استفاده از آمار و انتخاب آن دسته از متغیرهای ورودی است که قویترین رابطه را با متغیر هدف دارند. این روش ها می توانند سریع و موثر باشند، اگرچه انتخاب معیارهای آماری به نوع داده متغیرهای ورودی و خروجی بستگی دارد.

Neural Networks

شبکه های عصبی از فرآیند یادگیری در مغز انسان الهام می گیرند. آنها متشکل از یک شبکه مصنوعی از توابع به نام پارامترها هستند که به کامپیوتر اجازه می دهد با تجزیه و تحلیل داده های جدید، یاد بگیرد و خود را تنظیم کند. هر پارامتر که گاهی به عنوان نورون نیز شناخته می شود، تابعی است که پس از دریافت یک یا چند ورودی، خروجی تولید می کند. سپس آن خروجی ها به لایه بعدی نورون ها منتقل می شوند که از آنها به عنوان ورودی عملکرد خود استفاده می کنند و خروجی های بیشتری تولید می کنند. آن خروجیها سپس به لایه بعدی نورونها منتقل میشوند، و به همین ترتیب ادامه مییابد تا زمانی که هر لایه نورون در نظر گرفته شود و نورونهای انتهایی ورودی خود را دریافت کنند. سپس آن نورونهای پایانی نتیجه نهایی را برای مدل ارائه میدهند.

شکل زیر نمایش بصری چنین شبکه ای را نشان می دهد. ورودی اولیه x است، که سپس به اولین لایه نورون ها (حباب های h) ارسال می شود، جایی که سه تابع ورودی دریافتی را در نظر می گیرند و یک خروجی تولید می کنند. سپس آن خروجی به لایه دوم (حباب های g) منتقل می شود. در آنجا خروجی بیشتر بر اساس خروجی لایه اول محاسبه می شود. سپس آن خروجی ثانویه با هم ترکیب می شود تا خروجی نهایی مدل به دست آید.

یک راه برای تفکر در مورد شبکه عصبی این است که آن را به عنوان یک تابع عظیم در نظر بگیریم که ورودی ها را می گیرد و به خروجی نهایی می رسد. توابع واسطه ای که توسط نورون ها در لایه های متعدد آنها انجام می شود، معمولاً مشاهده نشده و خوشبختانه خودکار هستند. ریاضیات پشت آنها به همان اندازه که پیچیده است جالب است و شایسته نگاهی بیشتر است.

همانطور که قبلا ذکر شد، نورون های درون شبکه با نورون های لایه بعدی تعامل دارند و هر خروجی به عنوان ورودی برای عملکرد آینده عمل می کند. هر تابع، از جمله نورون اولیه، یک ورودی عددی دریافت میکند، و یک خروجی عددی را بر اساس یک تابع درونی شده تولید میکند، که شامل اضافه کردن یک عبارت بایاس است که برای هر نورون منحصربهفرد است. سپس آن خروجی با ضرب در وزن مناسب به ورودی عددی تابع در لایه بعدی تبدیل می شود. این تا زمانی ادامه می یابد که یک خروجی نهایی برای شبکه تولید شود.

مشکل در تعیین مقدار بهینه برای هر عبارت بایاس و همچنین یافتن بهترین مقدار وزنی برای هر عبور در شبکه عصبی نهفته است. برای انجام این کار، باید تابع هزینه را انتخاب کرد. تابع هزینه روشی برای محاسبه میزان فاصله یک راه حل خاص با بهترین راه حل ممکن است. بسیاری از توابع هزینه ممکن مختلف وجود دارد که هر کدام دارای مزایا و معایبی هستند که هر کدام در شرایط خاصی مناسب ترند. بنابراین، تابع هزینه باید بر اساس نیازهای تحقیقاتی فردی تنظیم و انتخاب شود. هنگامی که یک تابع هزینه مشخص شد، شبکه عصبی را می توان به گونه ای تغییر داد که تابع هزینه را به حداقل برساند.

یک راه ساده برای بهینهسازی وزنها و بایاس، اجرای چندباره شبکه است. در اولین تلاش، پیشبینیها لزوماً تصادفی خواهند بود. پس از هر بار تکرار، تابع هزینه تجزیه و تحلیل خواهد شد تا مشخص شود که مدل چگونه انجام شده و چگونه می توان آن را بهبود بخشید. سپس اطلاعات بدست آمده از تابع هزینه به تابع بهینه سازی منتقل می شود که مقادیر وزن جدید و همچنین مقادیر سوگیری جدید را محاسبه می کند. با ادغام مقادیر جدید در مدل، مدل مجددا اجرا می شود. این کار تا زمانی ادامه می یابد که هیچ تغییری باعث بهبود عملکرد هزینه نشود.

Support vector machine

SVM یک الگوریتم طبقه بندی بسیار پرکاربرد است که براساس تئوری یادگیری آماری ساخته شده است. مسئله ی اصلی SVM یافتن یک ابر صفحه ای در فضایی است که حداکثر حاشیه بین نمونه ها در دو کلاس باشد. برای این منظور، SVM همیشه از طریق kernel trick، نمونه ها را در فضایی با ابعاد بالاتر، جایی که یک ابر صفحه ی مطلوب به راحتی استخراج می شود، ترسیم می کند. تا به امروز، چندین نوع SVM برای مقابله با مسائل مختلف ارائه شده است. برای نمونه می توان به شکل 1 توجه کرد.

شکل1 : یک تصویر ساده از طبقه بندی SVM خطی از داده های ورودی. شکل از سخنرانی های مرتبط با ML گرفته شده است. تومورها با توجه به اندازه و سن بیمار طبقه بندی می شوند. فلش های به تصویر کشیده تومورهای طبقه بندی اشتباه را نشان می دهد.

KNN و یادگیری نظارت شده

K Nearest Neighbor یکی از الگوریتم های اساسی در یادگیری ماشین است. مدل های یادگیری ماشین از مجموعه ای از مقادیر ورودی برای پیش بینی مقادیر خروجی استفاده می کنند. KNN یکی از ساده ترین اشکال الگوریتم های یادگیری ماشینی است که بیشتر برای طبقه بندی استفاده می شود. این روش نقطه داده را نسبت به همسایه خود طبقه بندی می کند.

KNN نقاط داده جدید را بر اساس اندازه گیری شباهت نقاط داده ذخیره شده قبلی طبقه بندی می کند. برای مثال، اگر مجموعه داده ای از گوجه فرنگی و موز داشته باشیم. KNN اقدامات مشابهی مانند شکل و رنگ را ذخیره می کند. هنگامی که یک شی جدید می آید، شباهت آن را با رنگ (قرمز یا زرد) و شکل بررسی می کند.

K در KNN نشان دهنده تعداد نزدیکترین همسایه هایی است که ما برای طبقه بندی نقاط داده جدید استفاده کردیم.

Decision tree

الگوریتم درخت تصمیم یک الگوریتم یادگیری نظارت شده ساده و در عین حال کارآمد است که در آن نقاط داده به طور مداوم بر اساس پارامترهای خاص و/یا مشکلی که الگوریتم در تلاش برای حل آن است تقسیم می شود. درختهای تصمیم معمولاً به عنوان CART (که مخفف درختان طبقهبندی و رگرسیون است) نیز شناخته میشوند.

هر درخت تصمیم شامل یک گره ریشه، چند شاخه و گره برگ است. گره های داخلی موجود در درخت، موارد مختلف آزمایش را توصیف می کنند. از درختان تصمیم می توان برای حل مسائل طبقه بندی و رگرسیون استفاده کرد. الگوریتم را می توان به عنوان یک ساختار درخت مانند در نظر گرفت که از پارامترهای تنظیم شده مختلفی برای پیش بینی نتایج استفاده می کند. درخت های تصمیم یک رویکرد از بالا به پایین را برای مجموعه داده ای که در طول آموزش تغذیه می شود، اعمال می کنند.

گردش کار معمول یک سیستم یادگیری ماشین

گردش کار معمول در یک سیستم یادگیری ماشین به طور کلی شامل شش مرحله است: جمع آوری داده ها ، پیش پردازش داده ها ، آموزش مدل، ارزیابی مدل، استفاده از مدل و تفسیر مدل. روند معمول سیستم های یادگیری ماشین در شکل زیر نشان داده شده است. فرایند کلی یک سیستم یادگیری ماشین به این صورت است که در ابتدا، مجموعه داده ها از منابع مختلف به اشکال مختلف مانند داده های ساخت یافته، غیر ساخت یافته یا نیمه ساخت یافته جمع آوری می شوند. پیش پردازش داده ها شامل نرمال سازی، گسسته سازی، پر کردن مقدار گم شده، حذف همبستگی بسیار بالا بین متغیر های مستقل، تقسیم بندی داده های آموزش و تست، داده ورزی و غیره است. آموزش مدل مرحله اصلی یادگیری ماشین است، که شامل انتخاب مدل، بهینه سازی عملکرد هدف، تنظیم شرایط توقف آموزش، اعتبار سنجی، تنظیم hyperparameter و غیره است. در مرحله ارزیابی مدل، از مجموعه داده های آزمون برای ارزیابی عملکرد مدل با اندازه گیری دقت و رسم منحنی ROC و غیره استفاده می شود. سپس مدل آموزش دیده برای پیش بینی مجموعه های داده جدید استفاده می شود. علاوه بر این، گاهی اوقات ما می خواهیم بدانیم که یک مدل چگونه پیش بینی های خود را انجام می دهد. در چنین حالتی، برای توضیح پیش بینی های مدل، اهمیت ویژگی ها به تنهایی یا تعامل بین ویژگی ها مورد نیاز است.

شکل 9: فرایند خاص یادگیری ماشین و یادگیری نظارت شده .

مطالعه صدها مطلب علمی در حوزه بیولوژی

آرشیو جدیدترین خبرهای روز دنیای بیولوژی